Capítulo 7: La Revolución del Lenguaje - Entendiendo LLMs

La Revolución del Lenguaje: Entendiendo LLMs

Con los LLMs por todas partes, Víctor, Marta y Luis se preguntan cómo encajan en Minermont; Alma los guía por tokenización, embeddings y atención.

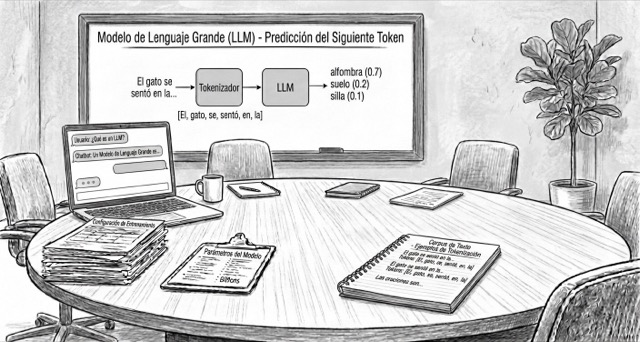

Los Modelos de Lenguaje Grande como GPT y Claude están en todas partes, generando texto similar al humano, respondiendo preguntas y asistiendo con diversas tareas. El equipo de Minermont los ha estado usando informalmente, pero ¿cómo podrían los LLM encajar en la atención médica donde la privacidad del paciente es primordial? A diferencia de las redes neuronales convolucionales para imágenes, los LLM enfrentan desafíos únicos: el texto es secuencial, dependiente del contexto e infinitamente variable. El equipo se embarca en su viaje de aprendizaje más ambicioso hasta ahora, explorando tokenización (cómo las palabras se convierten en números), incrustaciones (cómo el significado se captura en espacio vectorial), mecanismos de atención (cómo los modelos entienden el contexto) y arquitecturas transformadoras (la base de los LLM modernos). Esta primera parte sienta los fundamentos cruciales para entender cómo funcionan realmente los modelos de lenguaje bajo la superficie.

En este capítulo, te unirás al equipo en la exploración de los pilares fundamentales sobre los que se construyen todos los LLMs: la tokenización y las representaciones semánticas.

7.1 El Artesano de Palabras: El Tokenizador BPE: Descubrirás el algoritmo Byte-Pair Encoding (BPE). En esta simulación interactiva, no solo verás cómo funciona, sino que entrenarás tu propio tokenizador. Comprenderás por qué este proceso de "aprender un vocabulario" es crucial para que un modelo de IA pueda procesar eficientemente la jerga médica, las abreviaturas y la riqueza del lenguaje humano.

7.1 Embedding Projector: Visualizando Vectores de Palabras: Explorarás cómo las palabras se transforman en vectores matemáticos en espacios de alta dimensión, donde el significado emerge de la geometría. Usando el TensorFlow Embedding Projector, visualizarás cómo los modelos de lenguaje organizan el conocimiento médico, agrupando términos relacionados y capturando relaciones semánticas complejas.

7.3 Visualización de LLMs: Ver la IA por Dentro: Descubrirás el funcionamiento interno de un modelo de lenguaje grande mediante una visualización 3D interactiva. Podrás observar cómo fluye la información a través de las capas, cómo funciona el mecanismo de atención, y cómo el modelo finalmente predice la siguiente palabra. Esta herramienta conecta todo lo aprendido en el capítulo en una experiencia visual única.

7.4 Juego Interactivo: Entrenando un Modelo de Lenguaje: Experimenta cómo un modelo de lenguaje mejora progresivamente sus predicciones a medida que ajusta sus parámetros internos. En este juego educativo, entrenarás una pequeña red neuronal sobre un corpus temático, observando visualmente cómo los valores cambian con cada ejemplo procesado.

7.5 Panorama de LLMs: los modelos más relevantes: Un mapa práctico de las familias de modelos actuales (APIs “frontier”, open-weight autoalojables, opciones en dispositivo) y sus trade-offs en despliegues reales.

7.6 Benchmarks de LLM: vigentes vs. saturados: Guía curada de los benchmarks más usados, cuáles siguen diferenciando modelos y dónde verificar afirmaciones de leaderboards.

7.7 Artificial Analysis: comparar modelos por capacidad, coste, velocidad y apertura: Explorarás una plataforma de comparación que reúne rankings, benchmarks, coste, velocidad y apertura en un mismo sitio, para entender mejor cómo se comparan los LLMs en la práctica.

7.8 Arena Leaderboard: comparar modelos por preferencia humana: Descubrirás cómo funciona una clasificación basada en comparaciones ciegas entre respuestas, y por qué la preferencia humana añade una dimensión distinta a la evaluación de los LLMs. Prepárate para dar los primeros pasos en el viaje hacia la comprensión del lenguaje artificial, una habilidad que está transformando la medicina y el mundo.

Pseudocódigo de Algoritmos

- 📝 Pseudocódigo de Word2Vec: Arquitecturas Skip-Gram y CBOW, muestreo negativo, softmax jerárquico y técnicas de submuestreo.

Fundamentos Matemáticos

- Tokenización y geometría de embeddings: Matemáticas de BPE y la geometría del espacio de embeddings que sustentan el simulador de tokenizador y el proyector.

- Teorema de aproximación universal: Por qué una sola capa oculta puede aproximar cualquier función continua en un compacto (con referencias clave).

Bibliografía y Recursos Complementarios

- 📚 Bibliografía: LLMs y Tokenización: Recursos y referencias verificadas sobre Large Language Models, transformers, tokenización y el algoritmo BPE.

- 📚 Bibliografía: Transformers y Mecanismos de Atención: Papers fundamentales, recursos educativos, blogs oficiales, entrevistas y herramientas sobre arquitecturas Transformer y sus aplicaciones.