7.3 Visualización de LLMs: Ver la IA por Dentro

Introducción

Hasta ahora hemos aprendido cómo se procesan las palabras (tokenización) y cómo se representan sus significados (embeddings). Pero, ¿qué sucede dentro de un modelo de lenguaje cuando genera una respuesta?

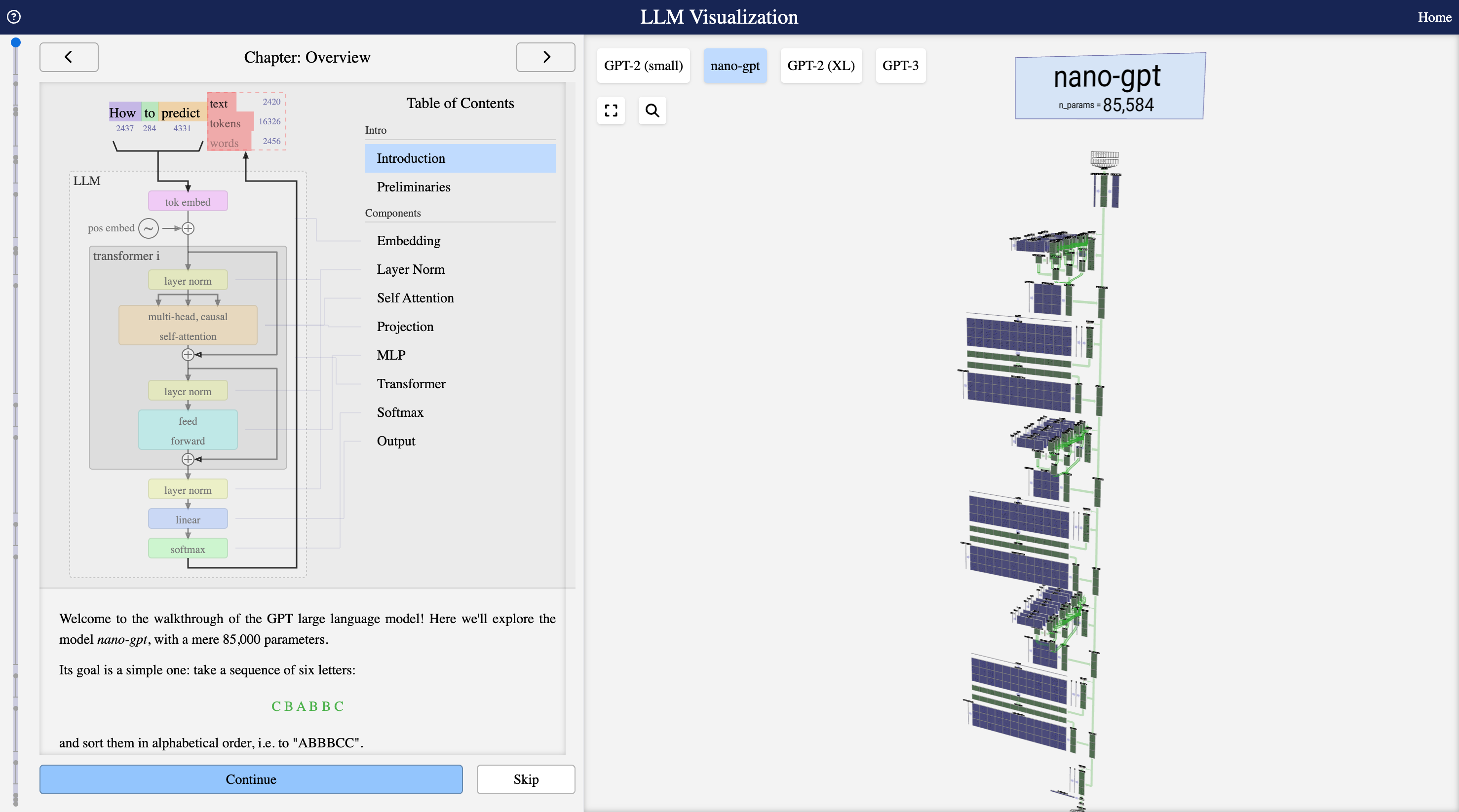

Imagina poder ver el interior de un cerebro artificial mientras piensa, ver cómo fluye la información a través de cada capa, cómo se transforman los vectores y cómo finalmente emerge una palabra predicha. Esto es exactamente lo que permite la visualización 3D interactiva de LLM creada por Brendan Bycroft.

Esta herramienta te permite explorar visualmente un modelo GPT pequeño, siguiendo paso a paso el viaje de un token desde la entrada hasta la salida generada.

¿Qué es un LLM?

Lo Esencial de los LLMs

Un Large Language Model (LLM) o Modelo de Lenguaje Grande es un tipo de IA que puede:

- Entender texto: Comprender el significado y contexto de lo que lee

- Generar texto: Crear respuestas coherentes y relevantes

- Aprender patrones: Identificar relaciones complejas en el lenguaje

- Predecir: Adivinar qué palabra viene después basándose en el contexto

¿Cómo funciona? El modelo procesa el texto a través de múltiples capas de transformación, donde cada capa refina la comprensión y añade más contexto. Es como pasar información por una cadena de especialistas, donde cada uno añade su perspectiva única.

La Visualización Interactiva de LLM

La herramienta de Brendan Bycroft (https://bbycroft.net/llm) ofrece una ventana única al funcionamiento interno de un modelo GPT. A diferencia de las explicaciones teóricas, aquí puedes ver y explorar cada componente en acción.

Figura: Visualización 3D de la arquitectura de un modelo de lenguaje grande. Puedes rotar, hacer zoom y explorar cada capa del modelo. Haz clic en la imagen para abrir la herramienta interactiva en bbycroft.net/llm.

¿Qué Puedes Ver en la Visualización?

Componentes Principales

1. Tokens de Entrada

- Ves cómo el texto se divide en tokens (como aprendimos en 7.1)

- Cada token se convierte en un vector de números

2. Embeddings

- Los tokens se transforman en embeddings (como vimos en 7.2)

- Puedes ver las dimensiones de estos vectores

3. Capas de Atención

- La parte más fascinante: el mecanismo de "atención"

- El modelo decide qué palabras son importantes para entender cada palabra

- Es como cuando lees una frase y prestas más atención a ciertas palabras clave

4. Capas de Transformación (Feed-Forward)

- Aquí es donde el modelo "piensa" y procesa la información

- Los vectores pasan por operaciones matemáticas complejas

- Cada capa refina la comprensión

5. Predicción Final

- Al final, el modelo genera probabilidades para cada palabra posible

- La palabra con mayor probabilidad es la que se elige como respuesta

El Mecanismo de Atención

El concepto más importante en los LLMs modernos es la atención (attention). Piensa en ello así:

Cuando lees la frase: "El paciente tiene diabetes y necesita insulina"

Tu cerebro automáticamente conecta:

- "diabetes" con "insulina" (tratamiento relacionado)

- "paciente" con "tiene" y "necesita" (sujeto de las acciones)

El mecanismo de atención hace exactamente esto: conecta palabras relacionadas para entender el contexto completo. En la visualización, puedes ver estas conexiones como líneas entre tokens.

Explora Cómo Funciona la Atención

En la herramienta interactiva, prueba lo siguiente:

- Escribe una frase médica: Por ejemplo, "The patient needs treatment"

- Observa las capas de atención: Verás líneas que conectan palabras relacionadas

- Sigue un token específico: Selecciona una palabra y observa cómo su representación cambia en cada capa

- Mira la predicción: Al final, el modelo sugiere qué palabra debería venir después

Nota: La visualización usa un modelo pequeño con propósitos educativos, no un LLM completo de producción.

De Tokens a Texto: El Viaje Completo

Ahora podemos conectar todo lo que hemos aprendido en el Capítulo 7:

El Pipeline Completo

Paso 1: Tokenización (7.1)

"El paciente tiene fiebre" → ["El", "paciente", "tiene", "fiebre"]Paso 2: Embeddings (7.2)

["El", "paciente", "tiene", "fiebre"] → [vector₁, vector₂, vector₃, vector₄]Paso 3: Procesamiento en Capas (7.3 - Esto que estamos viendo ahora)

- Los vectores pasan por múltiples capas de atención y transformación

- Cada capa refina la comprensión del contexto

- El modelo aprende relaciones complejas entre palabrasPaso 4: Predicción

El modelo predice la siguiente palabra: "alta" (probabilidad 0.85)

Frase completa: "El paciente tiene fiebre alta"¿Por Qué es Importante para la Medicina?

Los LLMs están transformando la medicina de múltiples formas:

Aplicaciones Clínicas Actuales

1. Resumen de Historias Clínicas

- Leer miles de notas y extraer información clave

- Identificar patrones en evoluciones de pacientes

- Generar resúmenes concisos para revisión rápida

2. Asistencia en Diagnóstico

- Analizar síntomas y sugerir diagnósticos diferenciales

- Conectar información dispersa en múltiples informes

- Alertar sobre interacciones medicamentosas

3. Búsqueda de Información Médica

- Responder preguntas sobre tratamientos basándose en literatura médica

- Encontrar casos similares en bases de datos

- Traducir jerga médica a lenguaje comprensible para pacientes

4. Generación de Informes

- Ayudar a redactar informes médicos estructurados

- Sugerir códigos diagnósticos apropiados (CIE-10)

- Completar documentación administrativa

⚠️ Consideraciones Importantes

Los LLMs son herramientas de apoyo, no reemplazos del criterio médico:

- ✅ Usar para: Buscar información, sugerir posibilidades, automatizar tareas administrativas

- ❌ No usar para: Tomar decisiones médicas finales sin supervisión humana

- 🔒 Siempre: Proteger la privacidad del paciente y validar la información generada

- 📚 Recordar: Son probabilísticos, pueden generar información incorrecta ("alucinaciones")

Conceptos Clave para Recordar

Resumen del Capítulo 7

7.1 Tokenización (BPE)

- Las palabras se dividen en piezas manejables

- El modelo aprende un vocabulario óptimo

7.2 Embeddings

- Cada palabra se convierte en un vector de números

- Las palabras similares tienen vectores similares

- El significado emerge de la geometría

7.3 LLM (Visualización)

- Los vectores pasan por múltiples capas de procesamiento

- El mecanismo de atención conecta palabras relacionadas

- Al final, el modelo predice la siguiente palabra más probable

Juntos, estos tres elementos forman la base de todos los modelos de lenguaje modernos, desde ChatGPT hasta los asistentes médicos de IA.

Explora y Aprende

Experimentos Recomendados

Para profundizar tu comprensión, prueba estos experimentos en la visualización:

- Compara frases simples vs. complejas: ¿Cómo cambian los patrones de atención?

- Observa palabras médicas: Escribe términos como "diagnosis", "treatment", "patient"

- Sigue un token específico: Selecciona una palabra y observa su viaje por todas las capas

- Cambia la entrada gradualmente: Modifica una palabra y observa cómo afecta todo el modelo

- Cuenta las capas: ¿Cuántas capas de atención tiene este modelo pequeño?

Reflexiona: Si este es un modelo pequeño con pocas capas, ¿te imaginas la complejidad de GPT-4 con cientos de capas y miles de millones de parámetros?

Conclusión

Del Concepto a la Práctica

La visualización interactiva de LLM cierra el círculo de comprensión del Capítulo 7. Ya no son cajas negras misteriosas: ahora puedes ver cómo funciona cada componente.

Lo que hemos aprendido:

- Los LLMs no son mágicos, son arquitecturas matemáticas sofisticadas

- El mecanismo de atención es la clave para entender el contexto

- Cada capa añade una nueva perspectiva de comprensión

- La predicción de texto es probabilística, basada en patrones aprendidos

Para la medicina AI:

Esta comprensión es fundamental para:

- Confiar en las herramientas: Entender sus capacidades y limitaciones

- Usarlas efectivamente: Saber qué pueden y no pueden hacer

- Desarrollar nuevas aplicaciones: Adaptar LLMs para necesidades médicas específicas

- Evaluar resultados: Distinguir entre predicciones confiables y "alucinaciones"

El futuro de la medicina inteligente depende de profesionales que no solo usen estas herramientas, sino que comprendan sus fundamentos. Este capítulo te ha dado esa base.

Referencias y Recursos Adicionales

- LLM Visualization (Interactive) - Exploración 3D interactiva de arquitecturas de transformers

- The Illustrated Transformer - Explicación visual detallada de la arquitectura transformer

- Attention is All You Need (Paper Original) - El paper que introdujo el mecanismo de atención

- OpenAI GPT Architecture - Documentación sobre la arquitectura GPT